Hadoop是一个开源的分布式计算框架,由Apache软件基金会开发和维护,旨在高效处理大规模数据集。它基于Google的MapReduce和Google File System(GFS)论文设计,广泛应用于大数据分析和软件开发领域。本文将从Hadoop的核心组件、架构原理、优势与挑战,以及在软件开发中的应用场景进行详细分析。

Hadoop核心组件

Hadoop生态系统主要由两个核心部分组成:Hadoop Distributed File System(HDFS)和MapReduce。

- HDFS(Hadoop分布式文件系统):这是一个高度容错的分布式存储系统,设计用于运行在廉价硬件上。它将数据分割成块(通常为128MB或256MB),并复制到多个节点上,确保数据冗余和可靠性。HDFS采用主从架构,包括NameNode(管理文件系统元数据)和DataNode(存储实际数据)。在软件开发中,HDFS提供了一个可扩展的存储基础,支持海量数据的读写操作。

- MapReduce:这是一个编程模型,用于并行处理大规模数据集。它将计算任务分为两个阶段:Map和Reduce。Map阶段对输入数据进行过滤和排序,生成中间键值对;Reduce阶段则对中间结果进行聚合。这种模型简化了分布式编程,使开发人员能够专注于业务逻辑,而无需处理底层并行化细节。

Hadoop生态系统还包括其他重要工具,如YARN(资源管理器)、Hive(数据仓库工具)、Pig(数据流语言)和HBase(NoSQL数据库),这些工具扩展了Hadoop的功能,使其在软件开发中更加灵活。

Hadoop架构原理

Hadoop采用分布式架构,运行在集群环境中。集群由多个节点组成,包括主节点(如NameNode和ResourceManager)和从节点(如DataNode和NodeManager)。数据被分割存储在多台机器上,计算任务并行执行,从而显著提高处理速度。HDFS通过数据复制(默认3份)确保高可用性,而MapReduce通过任务调度和容错机制自动处理节点故障。这种架构使Hadoop能够水平扩展,即通过增加节点来提升性能,非常适合处理PB级别的数据。

Hadoop的优势与挑战

优势:

- 可扩展性:Hadoop可以轻松扩展到数千个节点,处理海量数据。

- 成本效益:它运行在廉价硬件上,降低了基础设施成本。

- 容错性:自动处理节点故障,确保数据不丢失。

- 灵活性:支持结构化、半结构化和非结构化数据,适用于多种应用场景。

挑战:

- 复杂性:部署和维护Hadoop集群需要专业知识,增加了开发难度。

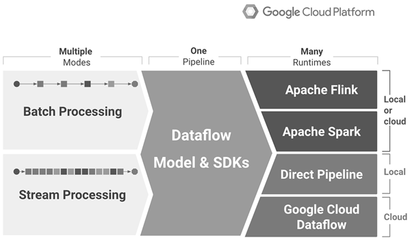

- 实时性不足:MapReduce批处理模型不适合实时分析,需要结合其他工具如Spark。

- 安全风险:早期版本的安全机制较弱,需通过Kerberos等工具加强。

Hadoop在软件开发中的应用

在软件开发中,Hadoop被广泛应用于大数据处理、日志分析、机器学习等领域。例如:

- 数据仓库构建:使用Hive或Pig,企业可以构建ETL(提取、转换、加载)管道,处理交易数据并生成报告。

- 推荐系统:电商平台利用Hadoop分析用户行为数据,实现个性化推荐。

- 日志处理:互联网公司使用MapReduce处理服务器日志,识别性能瓶颈和安全威胁。

Hadoop框架为软件开发提供了强大的分布式计算能力,尽管存在一些挑战,但通过生态系统工具的补充,它已成为大数据时代不可或缺的技术。开发人员应结合项目需求,合理选择Hadoop组件,以优化数据处理流程。